批归一化(bn)已成为许多先进深度学习模型的重要组成部分,尤其是在计算机视觉领域。它通过批处理中计算的均值和方差来标准化层输入,因此得名。为了使bn有效,批大小必须足够大,通常至少为32。然而,在某些情况下,我们不得不使用小批量:

- 当每个数据样本高度消耗内存时,例如视频或高分辨率图像

- 当我们训练一个很大的神经网络时,它只留下很少的GPU内存来处理数据

因此,我们需要BN的替代品,它能在小批量下很好地工作。组归一化(GN)是一种最新的标准化方法,可以避免利用批处理,因此与批处理大小无关。

为了更好地理解GN,我们首先回顾一下之前的一些标准化方法。

对于每个系数xᵢ输入特性,标准化公式为:

其中?ᵢ和?ᵢ²是集合Sᵢ中系数的均值和方差,?是一个小的常数,用于数值稳定,避免除零。唯一的区别在于集合Sᵢ的选择方式。

我们通过一个例子来解释不同归一化方法的计算,假设一批N = 3的输入特征a, b, c,它们有通道c = 4,高度H = 1,宽度W = 2:

因此批处理的形状为(N、C, H, W) = (3、4、1、2)。我们设?= 0.00001。

批归一化(BN)规范化通道,并计算?ᵢ和?ᵢ沿轴(N、H、W)。批次ᵢ系数被定义为同一通道的批处理中的一组xᵢ。

对于第一系数aᵢ= 2,i=(0,0,0),计算第一个通道的?ᵢ和?ᵢ²:

代入归一化公式,

计算a的所有系数:

层归一化(LN)旨在克服BN的缺点,包括对批大小的限制。计算?ᵢ和?ᵢ沿(C、H、W)轴,Sᵢ定义为同一输入特征的所有系数。因此,一个输入特征的计算完全独立于批处理中的其他输入特征。

所有的系数使用相同的归一化?ᵢ和?ᵢ²:

计算a的所有系数:

实例归一化(IN)可以看作是将BN公式单独应用到每个输入特性(又称实例),就好像它是批处理中的唯一成员一样。更准确地说,计算?ᵢ和?ᵢ沿轴(H, W),Sᵢ的系数被定义为一组相同的输入特性和xᵢ也在同一个通道。

由于IN的计算与批大小为1时BN的计算相同,在大多数情况下,IN实际上会使情况变得更糟。而对于样式转换任务,IN在丢弃图像对比度信息方面优于BN。

对于第一系数aᵢ= 2,i=(0,0,0),相应的?ᵢ和?ᵢ²只是:

代入归一化公式,

得到:

组归一化(GN)是IN和LN的中间点。将通道分成不同的组,计算?ᵢ和?ᵢ沿(H, W)轴和一组通道。批次ᵢ然后组系数,在相同的输入特性和同一组xᵢ通道。

组的数量G是一个预定义的超参数,通常需要它来划分c。为了简单起见,我们将通道按顺序分组。所以通道1,…,C / G属于第一组,通道C / G + 1,…,2C / G属于第二组,以此类推。当G = C时,即每组只有1个信道,则GN变为IN。另一方面,当G = 1时,GN变成LN。因此G控制了IN和LN之间的插值。

在我们的例子中,考虑G = 2。规范化的第一个系数aᵢ = 2,i=(0,0,0),我们使用的系数在4 / 2 = 2通道:

代入归一化公式,

对于a的其他系数,计算方法相似:

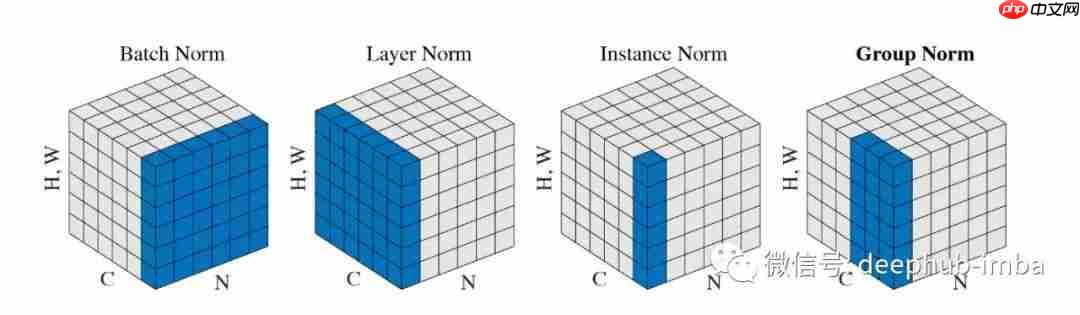

归一化方法比较

蓝色的区域对应的集Sᵢ计算?ᵢ和?ᵢ,然后用来标准化任何系数在蓝色区域。

从这个图中我们可以看到,GN如何在IN和LN之间插入。GN优于IN,因为GN可以利用跨通道的依赖关系。它也比LN好,因为它允许对每一组通道学习不同的分布。

当批大小较小时,GN始终优于BN。但是,当批处理大小非常大时,GN的伸缩性不如BN,可能无法匹配BN的性能。

引用: A. Kolesnikov, L. Beyer, X. Zhai, J. Puigcerver, J. Yung, S. Gelly, and N. Houlsby. Big Transfer (BiT): General Visual Representation Learning (2019), arXiv preprint. S. Qiao, H. Wang, C. Liu, W. Shen, and A. Yuille. Weight Standardization (2019), arXiv preprint. S. Santurkar, D. Tsipras, A. Ilyas, and A. Madry. How Does Batch Normalization Help Optimization? (2018), NIPS 2018. Y. Wu, and K. He. Group Normalization (2018), ECCV 2018. 作者:Wanshun Wong

路由网

路由网